Voorzichtigheid Geboden bij het Gebruik van Generatieve AI vanwege Risico's

Voorzichtigheid Geboden bij het Gebruik van Generatieve AI vanwege Risico's

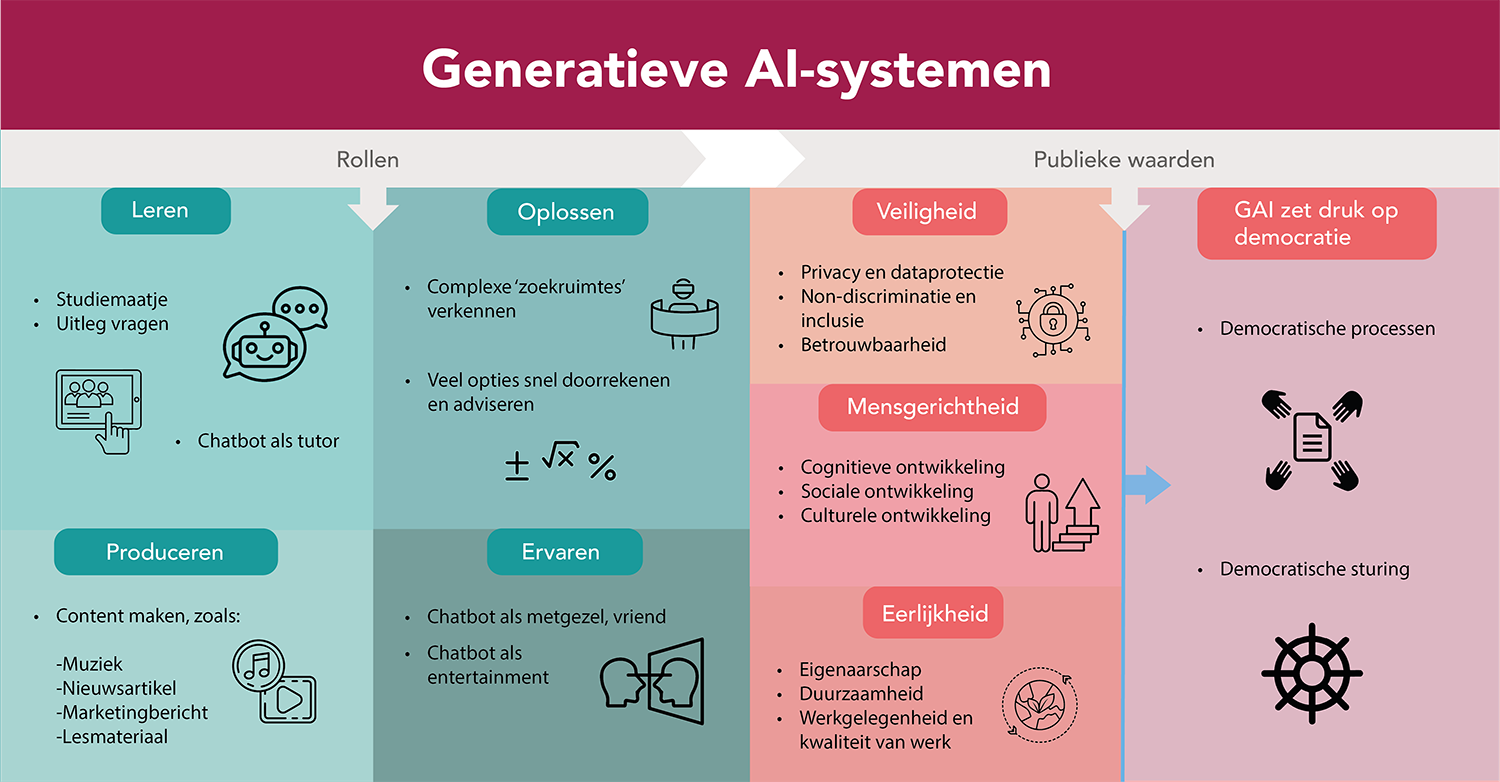

Generatieve AI-systemen, die verschillende risico's van digitalisering versterken, staan centraal in recent onderzoek van het Rathenau Instituut. De opkomst van deze systemen brengt bekende risico's zoals discriminatie en onveiligheid naar voren, terwijl er ook nieuwe uitdagingen ontstaan voor intellectueel eigendom en menselijke ontwikkeling. Het bestaande en aangekondigde beleid moet kritisch worden beoordeeld en mogelijk aangepast. Het instituut concludeert dat organisaties, bedrijven en burgers zich moeten afvragen of het verantwoord is om generatieve AI te gebruiken.

Er bestaat een reële mogelijkheid dat het huidige beleid, inclusief de toekomstige Europese AI-verordening, mogelijk ontoereikend is om de risico's van generatieve AI-systemen aan te pakken. Het Rathenau Instituut adviseert beleidsmakers om nationaal en Europees beleid te herzien en aan te scherpen. De AI-verordening zou moeten voorzien in de mogelijkheid om risicovolle generatieve AI-systemen van de markt te halen. Ondertussen zijn toezicht, afspraken met ontwikkelaars en maatschappelijk debat nodig om de wenselijkheid van generatieve AI-systemen zoals ChatGPT, Bard en DALL-E te bespreken.

Generatieve AI-systemen vergroten en compliceren de bekende risico's van digitalisering. Ze vereenvoudigen de productie van desinformatie en bemoeilijken de bescherming van gegevens. Transparantie over de werking van deze complexe AI-systemen is vrijwel onmogelijk. Daarnaast introduceren ze nieuwe risico's, met name voor de bescherming van intellectueel eigendom. De invloed van grote technologiebedrijven strekt zich verder uit naar domeinen als de wetenschap. Dit plaatst druk op democratische processen, zoals de toegang tot kennis, nieuwsvoorziening en publiek debat, en bemoeilijkt het verkrijgen van democratische controle over de technologie.

Linda Kool, onderzoekscoördinator bij het Rathenau Instituut, benadrukt dat politici en beleidsmakers zich nu moeten inzetten om de risico's van generatieve AI aan te pakken. Ze erkent echter dat het tijd zal kosten voordat het beleid daadwerkelijk effect heeft. In de tussentijd staan burgers en organisaties voor de uitdaging om te bepalen of ze op verantwoorde wijze gebruik kunnen maken van deze technologie.

De publicatie "Generatieve AI" van het Rathenau Instituut biedt een overzicht van de toepassingen van generatieve AI en de maatschappelijke impact ervan. Deze systemen vertegenwoordigen een doorbraak in de digitalisering doordat ze een breed scala aan taken kunnen uitvoeren en kunnen werken met verschillende modaliteiten, zoals tekst, beeld, geluid, eiwitstructuren en chemische verbindingen. Generatieve AI is met name effectief in taal, waardoor het kan worden ingezet in chatbots en niet-routinematige taken kan uitvoeren. Het onderzoek is uitgevoerd op verzoek van het ministerie van Binnenlandse Zaken en Koninkrijksrelaties, gebaseerd op literatuurstudie, werksessies en interviews met experts.

Ontvang gratis het laatste nieuws

Altijd up-to-date blijven van het laatste nieuws? Schrijf je dan in voor onze gratis nieuwsbrief met het laatste nieuws!